Défis de Sécurité et de Conformité de l’IA

Risque de Violation de Données

L’accès non contrôlé aux données par les systèmes d’IA augmente le risque de fuites d’informations sensibles, car ces systèmes manquent souvent de contrôles de sécurité intégrés. Sans une gouvernance appropriée, l’accès non autorisé aux données peut entraîner des violations graves qui exposent des informations confidentielles. À mesure que les systèmes d’IA s’intègrent davantage aux environnements d’entreprise, protéger les données contre ces risques devient plus crucial que jamais.

Exigences de Conformité en Matière de Gouvernance

Naviguer dans des cadres réglementaires complexes comme le RGPD, le CCPA, et les normes spécifiques à l’industrie est crucial lors de la gestion de données sensibles dans des environnements pilotés par l’IA. Les entreprises doivent s’assurer que les systèmes d’IA n’accèdent, n’utilisent et ne stockent les données qu’en conformité avec ces réglementations, sous peine de lourdes amendes et d’atteinte à la réputation. Des politiques de gouvernance efficaces sont nécessaires pour maintenir l’accès aux données en accord avec ces exigences légales en constante évolution.

Complexités d’Intégration

Les systèmes d’IA doivent souvent extraire des données de diverses sources, dont certaines peuvent être des systèmes hérités ou manquer des protocoles de sécurité nécessaires. Ce processus devient problématique lorsque les organisations tentent de maintenir l’intégrité et la sécurité des données à travers plusieurs plateformes et formats. Sans une approche rationalisée de l’intégration, les entreprises risquent de créer des vulnérabilités que les hackers peuvent exploiter.

Problèmes de Transparence

Lorsque les systèmes d’IA accèdent aux données d’entreprise, il est essentiel de maintenir une visibilité sur qui utilise ces données et à quelles fins. Sans suivi et audit clairs, les organisations manquent de la transparence nécessaire pour prévenir l’utilisation non autorisée des données et garantir la responsabilité. Ce manque de visibilité peut saper la confiance dans les processus pilotés par l’IA et entraîner des violations de conformité.

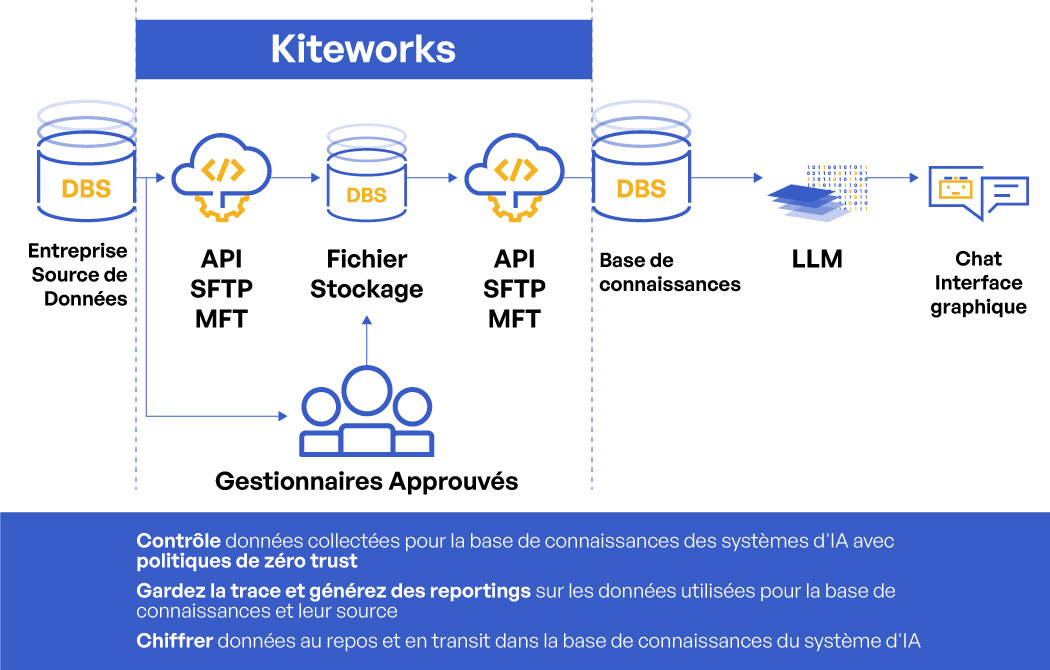

Kiteworks AI Data Gateway

Accès sécurisé aux données AI

La passerelle AI de Kiteworks offre un pont sécurisé entre les systèmes AI et les dépôts de données d’entreprise, garantissant que seules les entités autorisées peuvent accéder aux informations sensibles. En utilisant les principes de zéro trust, Kiteworks empêche l’accès non autorisé et protège les données contre les potentielles violations. Cette passerelle sécurisée ne se contente pas de réduire les risques, elle permet également aux organisations d’adopter les technologies AI en toute confiance sans compromettre la sécurité des données.

Gouvernance et Conformité

Kiteworks applique des politiques de gouvernance strictes, garantissant que chaque interaction entre les systèmes AI et les données d’entreprise est conforme aux réglementations pertinentes. La plateforme applique automatiquement des contrôles de gouvernance des données à chaque transaction, maintient des journaux d’audit et prévient les abus. Cette approche aide les organisations à rester conformes aux réglementations de protection des données telles que le RGPD, la HIPAA, et de nombreuses lois américaines sur la confidentialité des données tout en utilisant les systèmes AI pour l’innovation.

Chiffrement des Données et Traçabilité

Toutes les données transitant par la passerelle AI de Kiteworks sont chiffrées à la fois au repos et en transit, les protégeant contre l’accès non autorisé. La solution suit et rapporte également l’utilisation des données, offrant une visibilité en temps réel sur les utilisateurs et les systèmes ayant accédé à des ensembles de données spécifiques. Cela garantit que les entreprises ont un contrôle total sur leurs données et peuvent surveiller leur mouvement à travers les systèmes AI pour des raisons de conformité et de sécurité.

Facilite la Génération Augmentée par Récupération (RAG)

Kiteworks permet aux systèmes AI de récupérer en toute sécurité des données d’entreprise pertinentes pour la génération augmentée par récupération (RAG), améliorant ainsi la précision et la pertinence des modèles. En fournissant un accès contrôlé et sécurisé aux données à jour, Kiteworks aide les modèles AI à fonctionner plus efficacement sans augmenter le risque de violations de données. Cela facilite l’intégration de capacités AI avancées tout en maintenant des contrôles de sécurité stricts.

Intégration API Transparente

Avec des interfaces de programmation d’applications (API) conviviales pour les développeurs, Kiteworks s’intègre facilement dans les infrastructures AI existantes, réduisant le temps et la complexité nécessaires au déploiement. Cette intégration transparente permet aux entreprises de tirer parti de la puissance de l’AI sans la complexité supplémentaire de remanier leurs systèmes actuels. Ainsi, les organisations peuvent rapidement étendre les capacités AI tout en maintenant une sécurité et une gouvernance strictes sur leurs données.

FAQs

Les systèmes d’IA traitent souvent de grandes quantités de données sensibles, ce qui augmente le risque d’accès non autorisé ou de violations de données. Sans contrôles appropriés, l’IA pourrait utiliser abusivement ou exposer des informations confidentielles, entraînant une non-conformité réglementaire et une atteinte à la réputation.

Les systèmes d’IA peuvent manquer de protocoles de sécurité suffisants et divulguer involontairement des données via des connexions non sécurisées, le scraping de données ou l’utilisation abusive de jeux de données. Sans gouvernance appropriée, les données pourraient être accessibles par des entités non autorisées ou partagées avec des tiers non intentionnels.

Une gouvernance efficace des données garantit que les systèmes d’IA respectent des contrôles d’accès et des politiques d’utilisation stricts. Cela minimise le risque d’utilisation abusive des données et assure la conformité avec des réglementations comme le RGPD, empêchant l’accès non autorisé à des informations sensibles.

Oui, s’ils ne sont pas correctement sécurisés, les modèles d’IA peuvent être manipulés par des attaques adversariales ou des empoisonnements de données. Cela peut permettre à des acteurs malveillants de tromper les systèmes d’IA pour accéder ou exposer des données sensibles sans autorisation.

Le chiffrement protège les données sensibles en les rendant illisibles pour les utilisateurs non autorisés, tant lors de la transmission que du stockage. En chiffrant les données au repos et en transit, les organisations peuvent réduire le risque que le contenu sensible soit exposé par les systèmes d’IA.

RESSOURCES EN VEDETTE

Maîtriser les réglementations NIS-2, DORA et autres – Mettre en place une stratégie gagnante de mise en conformité

Kiteworks bat des records de ventes grâce à l’IA générative

IT, SECURITY, PRIVACY, AND COMPLIANCE LEADERS AT THOUSANDS OF THE WORLD’S LEADING ENTERPRISES AND GOVERNMENT AGENCIES TRUST KITEWORKS